Meta AI'dan SAM 2 (Segment Anything Model) 2

September 16, 2024

Gizem Argunşah

Çok Yönlü Uygulamalar için Güçlü Gerçek Zamanlı Nesne Takibi

Bu yapay zeka harikası, sabit video karelerindeki nesneleri gerçek zamanlı olarak sorunsuz bir şekilde izleyerek çok sayıda video düzenleme uygulamasına ve artırılmış gerçeklik içeren uygulamalara kapı açıyor. İlk Segment Anything Model’in (SAM) başarısı üzerine inşa edilen SAM 2, özünde üstün performans ve verimlilik sağlayarak görsel verileri bilgisayarla görme sistemlerini eğitmek için açıklanabilir hale getiriyor. Bu, canlı veya gerçek zamanlı bir videodaki nesnelerin seçimi ve bunlarla etkileşim için yeni yollar açar.

Bu yapay zeka harikası, sabit video karelerindeki nesneleri gerçek zamanlı olarak sorunsuz bir şekilde izleyerek çok sayıda video düzenleme uygulamasına ve artırılmış gerçeklik içeren uygulamalara kapı açıyor. İlk Segment Anything Model’in (SAM) başarısı üzerine inşa edilen SAM 2, özünde üstün performans ve verimlilik sağlayarak görsel verileri bilgisayarla görme sistemlerini eğitmek için açıklanabilir hale getiriyor. Bu, canlı veya gerçek zamanlı bir videodaki nesnelerin seçimi ve bunlarla etkileşim için yeni yollar açar.

SAM 2'nin Başlıca Özellikleri

Nesne Seçimi ve Ayarlama: SAM’ın komut tabanlı nesne segmentasyonunu, video kareleri boyunca nesne izleri üzerinde çalışacak şekilde genelleştirmek.

Bilinmeyen Videoların Sağlam Segmentasyonu: Görülmemiş alanlardan nesneleri, görüntüleri ve videoları segmentlere ayırmak için sıfır çekim genelleme, çeşitli gerçek dünya uygulamaları için kullanışlı olmasını sağlar.

Gerçek Zamanlı Etkileşim: Akış belleği mimarisi video karelerini tek tek işleyerek gerçek zamanlı etkileşim sağlar.

Performans İyileştirmeleri

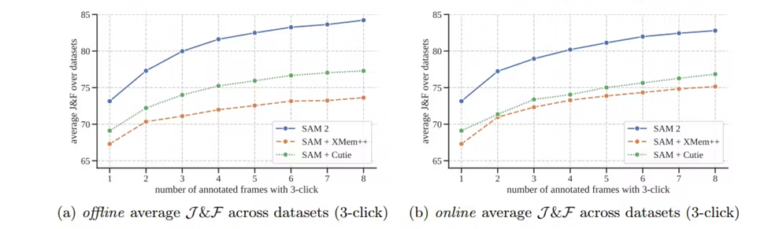

SAM 2, videoların ve görüntülerin segmentasyonunda yeni bir ölçüt oluşturmaktadır. Etkileşim sayısı üç kat azaltılarak video segmentasyonunda daha doğru olduğu kanıtlanmıştır; video ek açıklamaları 8 kat hızlandırılmıştır. Görüntü segmentasyonu için de önceki modelden daha doğru ve selefi SAM’den altı kat daha hızlıdır.

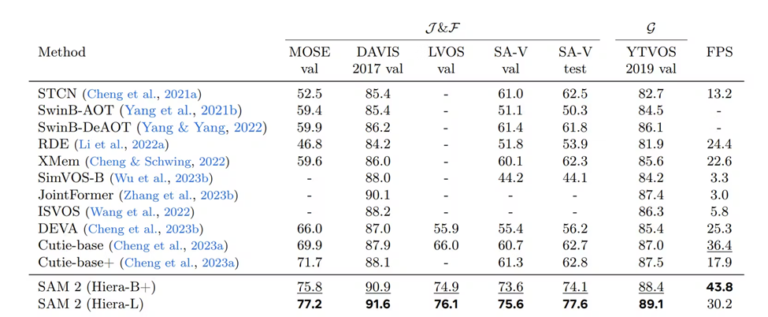

SAM 2 (Hiera-B+ ve Hiera-L), MOSE, DAVIS, LVOS, SA-V ve YTVOS dahil olmak üzere çeşitli video nesne segmentasyonu kıyaslamalarında mevcut son teknoloji (SOTA) modellerinden daha iyi performans gösterirken aynı zamanda rekabetçi bir çıkarım hızını da koruyor.

Meta AI, SAM 2’nin etkisinin basit video segmentasyonunun ötesine geçtiğine dikkat çekiyor: “Verilerimizin, modelimizin ve içgörülerimizin video segmentasyonu ve ilgili algılama görevleri için büyük bir kilometre taşı olacağına inanıyoruz.”

SAM 2'de Mimari Yenilikler

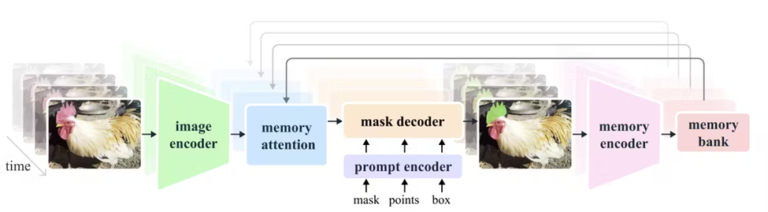

Çerçeve Gömme ve Bellek Koşullandırma: Bu, SAM 2’nin önceki karelerin çıktıları ve hızlı kareler üzerindeki kare gömme işlemlerini koşullandırmasını sağlar, böylece nesnelerin geçmişini ve hareketini anlayabilir.

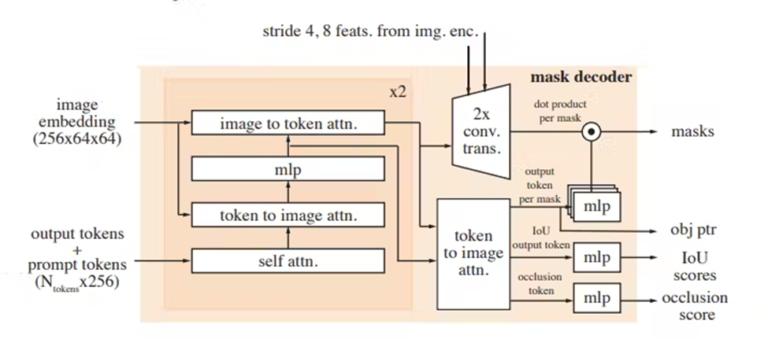

SAM 2’nin mimarisi, nesne maskeleri ve ilişkili güven puanları oluşturmak için görüntü kodlayıcı, maske kod çözücü ve çeşitli dikkat mekanizmaları aracılığıyla görüntü ve istem gömme akışını göstermektedir.

Bellek Kodlayıcı ve Bellek Bankası: Çerçeve belleğini mevcut tahmine göre yönetir ve bir FIFO (ilk giren ilk çıkar) kuyruğunun uygulandığı bir bellek bankasında saklar. Çok kısa vadeli zamansal konum bilgisi, kısa vadeli nesne hareketinin yakalanması için son karelerin belleklerine gömülür.

Görüntü Kodlayıcı: Video karelerini sırayla işleyen ve her karenin çok ölçekli özellik gömülerini oluşturan bir görüntü kodlayıcı.

Bellek Dikkat Mekanizması: Mevcut çerçeve özelliklerini geçmiş çerçeve özelliklerine, tahminlere ve yeni istemlere bir dönüştürücü blok yığını aracılığıyla koşullandırır, geçmişi ve bağlamı etkili bir şekilde birleştirir.

SAM 2’nin mimarisi, kareler arasında zamansal tutarlılığı koruyarak videolarda gerçek zamanlı nesne takibi ve segmentasyonu sağlar. Nesne maskeleri oluşturmak için görüntü ve istem katıştırmaları, bellek dikkati ve bir maske kod çözücü kullanır.

Teknik Eğitim ve Veri Seti

SAM 2, Hiera görüntü kodlayıcısının ön eğitim MAE’si ile önceden eğitilmiş SA-1B üzerinde ince ayarlanmıştır. Detektörler, görüntünün %90’ından fazlasını kapsayan maskeleri filtreleyerek ve DAVIS, MOSE ve YouTubeVOS gibi açık kaynaklı yapay zeka video veri kümeleriyle birlikte SA-V+Internal ve SA-1B dahil olmak üzere tam eğitim karışımlarıyla 64 rastgele örneklenmiş maske üzerinde eğitilerek uygulanır. Dolayısıyla, bu tam eğitimli yaklaşım, video kareleri boyunca etkili segmentasyon ve izlemeyi garanti etmenin yanı sıra etkileşimli iyileştirmelere de izin verebilir.

Bu SA-V veri kümesi, 47 ülkeden elde edilen yaklaşık 51.000 videodan alınan yaklaşık 600.000’den fazla maskeye sahiptir. Bu, veri kümesinin sağlam model performansı için gerçekçi ortamları nasıl taklit edebildiğini göstermektedir.

SAM 2'nin Kısıtlamaları

Çekim Değişiklikleri Boyunca Segmentleme: SAM 2, video çekimlerindeki değişiklikler boyunca nesne segmentasyonunu sürdürmekte zorlanabilir.

Kalabalık Sahneler: Model, yoğun nüfuslu sahnelerde nesnelerin izini kaybedebilir veya karıştırabilir.

Uzun Oklüzyonlar: Uzun süreli oklüzyonlar hatalara veya nesne takibinin kaybolmasına neden olabilir.

İnce Ayrıntılar: Çok ince veya ince ayrıntılara sahip nesnelerde, özellikle de hızlı hareket ediyorlarsa zorluklar ortaya çıkar.

Nesneler Arası İletişim: SAM 2, paylaşılan nesne düzeyinde bağlamsal bilgi olmadan birden fazla nesneyi ayrı ayrı işler.

Kalite Doğrulama: Masklet kalitesinin doğrulanması ve hataların düzeltilmesi için insan ek açıklamacılara olan mevcut bağımlılık otomasyon ile geliştirilebilir.

Umut verici olsa da SAM 2, AR, VR, robotik, otonom araçlar, video düzenleme ve görüntü düzeyinde segmentasyonu aşan doğru zamansal lokalizasyonun gerekli olduğu diğer birçok uygulama alanı gibi alanlarda şüphesiz bir devrim yaratmaktadır. Bu kullanılabilirlik işleminin ardından, video nesnesi segmentasyon çıktılarının modern video oluşturma modellerine girdi olarak kullanılabileceği ve böylece hassas düzenlemenin mümkün olabileceği umulmaktadır. Gerçek zamanlı ya da canlı video bağlamında yaratıcı etkileşimleri teşvik etmek için yeni tür giriş istemleriyle genişletmeye izin verilebilir.

SAM 2 en iyi doğruluğa, en iyi verimliliğe sahiptir ve birçok video ve görüntü segmentasyon görevinde en hızlısıdır. Gerçek zamanlı etkileşim ve bu tür görevlerdeki güçlü performans, SAM 2’nin kolayca geliştirebileceği alanlardan bazıları olacak ve farklı sektörlerdeki deneyimleri dönüştürmeyi vaat edecek. Şimdi, SAM 2 bir Apache 2.0 lisansı altında mevcut olduğundan, özetle, yapay zeka topluluğu genelinde bilgisayarla görme sistemlerinde yenilik ve gelişme sınır tanımayacaktır. GitHub deposunun linkine buradan ulaşabilirsiniz.