09.04.2026

EU AI Act Yasası Resmen Devrede: Şirketler İçin Yapay Zekada Uyum ve Aksiyon Zamanı

Avrupa Birliği'nin yeni EU AI Act Law düzenlemesiyle birlikte yapay zeka kullanımında risk temelli ve yüksek güvenilirlikli yeni bir dönem resmen başladı. Kurumunuzun bu regülasyonlara nasıl uyum sağlayacağını ve 2026 takvimine nasıl hazırlanması gerektiğini detaylandırıyoruz.

Navigation

Dünyanın ilk kapsamlı yapay zeka yasal çerçevesi olan Avrupa Yapay Zeka Yasası (EU AI Act), yapay zeka teknolojilerinin güvenli, şeffaf, ayrımcılıktan uzak ve temel haklara saygılı bir şekilde kullanılmasını güvence altına almayı amaçlamaktadır. 1 Ağustos 2024’te resmi olarak yürürlüğe giren ve Ağustos 2026 itibarıyla ana yükümlülükleri devreye girecek olan yasa, coğrafi sınırları aşan bir etkiye sahiptir. Avrupa Birliği pazarında yapay zeka sistemleri geliştiren, pazarlayan veya bu sistemlerin çıktılarını AB’deki kullanıcılar üzerinde uygulayan tüm şirketler, şirket merkezlerinin nerede olduğuna bakılmaksızın bu yasaya tabidir. Bu durum, EU AI Act’i tıpkı GDPR gibi tüm dünyada yapay zeka yönetiminin fiili standartlarını belirleyen evrensel bir kurallar bütünü haline getirmektedir.

EU AI Act'in 4 Kademeli Risk Mimarisi: Yapay Zekanın Oluşturdukları Belirsizliklerden Güvenli Ajanlara

Yasa, her bir yapay zeka sistemini dört farklı risk kategorisine ayırır. Uyumluluk yükümlülükleriniz tamamen yapay zekanızın hangi kategoriye düştüğüne bağlıdır. İşte bu dört seviyenin çalışma mantığı:

- Kabul Edilemez Risk : Bu kategorideki yapay zeka sistemleri Avrupa Birliği’nde hiçbir şekilde kullanılamaz ve tamamen yasaktır. Bu grupta; kamusal alanlarda gerçek zamanlı yüz tanıma ile biyometrik kimlik tespiti yapan sistemler, vatandaşları sosyal davranışlarına göre sınıflandıran sosyal puanlama, en çarpıcı örneklerden, Çin’in sosyal kredi modeli ve insanların kararlarını manipüle etmek için psikolojik zafiyetleri istismar eden yapay zeka sistemleri yer almaktadır. Bunlara ek olarak, iş yerlerinde çalışanların veya eğitim kurumlarında öğrencilerin duygularını tanımaya yönelik uygulamalar da bu mutlak yasak kapsamındadır. Bireylerin temel haklarını ve güvenliğini doğrudan tehdit eden bu sistemlere yönelik kesin yasaklar, Şubat 2025 itibarıyla resmen devreye girmiştir.

Yüksek Risk: Bu kategorideki yapay zeka sistemlerine izin verilir, ancak sıkı kontrollere tabidir. Sağlık, güvenlik veya temel haklar üzerinde ciddi risk oluşturma potansiyeline sahip yapay zeka sistemleri bu kategoridedir. Örneğin; İK süreçlerindeki CV eleme yazılımları, bankaların kredi onay/red puanlamaları, robotik cerrahi gibi ürün güvenlik bileşenleri ve ulaşım gibi kritik altyapı önlemleri doğrudan bu kapsama girer. Bu sistemlerin kullanımı serbesttir; ancak yapay zekanın eğitildiği veri setlerinin kalitesiz, eksik veya geçmişteki toplumsal önyargıları barındırıyor olması ayrımcılığa sebep olabilir. Bu durumu önlemek için yüksek kaliteli veri setleri kullanmak, risk değerlendirmesi yapmak, otomatik log tutmak ve sağlam bir insan gözetimi mekanizması kurmak zorundasınızÇoğu yüksek riskli sistem için bu kurallar Ağustos 2026‘da, halihazırda ürün güvenliği mevzuatlarına tabi olan bazı spesifik sistemler içinse Ağustos 2027‘de tam olarak yürürlüğe girecektir.

Şeffaflık ve Sınırlı Risk: Bu kategorideki yapay zeka sistemleri şeffaflık ve bilgilendirme gerektirir. Yapay zeka kullanımında insan güvenini korumak için tasarlanan bu kategori, kullanıcıların bir insanla değil, bir makineyle etkileşimde olduklarını açıkça bilmelerini zorunlu kılar. Şirketiniz müşteri hizmetlerinde “chatbotlar” kullanıyorsa veya “üretken yapay zeka (GenAI)” ile içerik oluşturuyorsa, buradaki temel yükümlülüğünüz karmaşık teknik dokümantasyonlar hazırlamak değil, doğrudan ifşa ve bilgilendirme sürecidir. Üretken yapay zeka sağlayan kurumlar, üretilen tüm içeriklerin yapay zeka formatında olduğunun tanımlanabilir olmasını sağlamalıdır. Özellikle kamuoyunu bilgilendirme amaçlı metinler yayınlıyor veya derin kurgu (deepfake) gibi manipüle edilmiş ses ve görüntü içerikleri üretiyorsanız, bu çıktıları net ve görünür bir şekilde etiketlemek zorundasınız. Kullanıcıların bilinçli kararlar almasını güvence altına alan bu şeffaflık ve etiketleme kuralları, Ağustos 2026 itibarıyla tam olarak yürürlüğe girecektir.

Minimum Risk: Bu kategoride yer alan yapak zeka sistemleri için zorunlu kural yoktur. Avrupa Birliği’nde halihazırda kullanılan yapay zeka sistemlerinin çok büyük bir kısmı bu kategoriye girmektedir ve Tüzük, bu sistemler için herhangi bir bağlayıcı kural veya ek yükümlülük getirmemektedir. Spam filtreleri, yapay zeka destekli video oyunları ve müzik öneri algoritmaları gibi tüketicilere yönelik günlük araçların çoğu bu grupta yer alır. Bu tür sistemleri kullanan şirketler için resmi bir yasal uyum programı hazırlamak şart olmasa da, yüksek kalite ve şeffaflık standartlarından ödün vermemek her zaman kazandıran bir yaklaşımdır.

Kurumsal Kör Nokta: "Gölge Yapay Zeka" [Shadow AI] Kabusu

Riskleri bilmek işin sadece teorik kısmıdır. Çoğu kurumsal şirket doğrudan kontrollere atlayıp “Neyi belgelendirmeliyiz?” diye sorar. Oysa asıl sorulması gereken şudur: “Şu anda şirketimizde hangi yapay zeka araçlarının çalıştığını gerçekten biliyor muyuz?”

Çalışanların işlerini hızlandırmak için IT veya Hukuk departmanlarından bağımsız olarak kullandığı uygulamalar, “Gölge Yapay Zeka”nın (Shadow AI) şirket içinde kontrolsüzce yayılmasına neden olur. Siz farkına bile varmadan kritik verileriniz sınıflandırılmamış sistemler tarafından işlenmeye başlar. Unutmayın; haritasını çıkarmadığınız bir sistemi yönetemez ve yasaya uyumlu hale getiremezsiniz.

Tam bu noktada SKYMOD, çalışanların dışarıdaki güvensiz ve denetimsiz yapay zeka araçlarına yönelmesini engeller. SkyStudio platformu sayesinde kurumlar; tüm yapay zeka iş akışlarını şifrelenmiş, erişim yetkileri belirlenmiş ve her adımı denetlenebilir tek bir güvenli ekosistemde toplayarak gölge yapay zeka riskini tamamen ortadan kaldırır

Yaptırımlar Sadece Teorik Değil

Birçok şirket bu yeni kuralları GDPR dönemindeki gibi zamanla halledilecek bir idari süreç olarak görebilir, ancak EU AI Act’in yaptırımları düzenleme tarihindeki en ağır cezalardan bazılarını içerir. Bu cezalar, ciroya oranlandığı için orta ve büyük ölçekli şirketler adına görmezden gelinip göze alınabilecek bütçeler değildir:

Yasaklı Sistemlerin Kullanımı: Şirketin küresel yıllık cirosunun %7’sine veya 35 milyon Euro’ya kadar idari para cezası.

Yüksek Risk Kurallarının İhlali: Yıllık küresel cironun %3’üne veya 15 milyon Euro’ya kadar ceza.

Yetkililere Yanlış Bilgi Verilmesi: Yıllık cironun %1.5’ine veya 7.5 milyon Euro’ya kadar ceza yaptırımı uygulanır.

Şirketler Bu Süreçte Ne Yapmalı? 3 Adımlık Eylem Planı

Yasal uyumluluk hazırlıklarına şu üç temel adımla hemen başlayabilirsiniz:

Yapay Zeka Envanterinizi Çıkarın: Şirketinizin kullandığı veya inşa ettiği tüm yapay zeka araçlarının haritasını çıkarın. Özellikle İK, Finans ve müşteriyle yüz yüze olan sistemlere odaklanın ve “Bu yapay zeka, insanları etkileyen kararlar alıyor mu?” sorusunu sorun.

Riskleri Sınıflandırın: Çıkardığınız envanteri yasanın dört seviyeli risk çerçevesine ve yüksek riskli kategorileri listeleyen Ek III belgesine göre sınıflandırın.

Kontrol Mekanizmaları Kurun ve Şirket Çalışanlarınızı Eğitin: Yüksek riskli sistemleriniz için teknik dokümantasyon, denetim logları ve sağlam bir insan gözetimi mekanizması inşa edin. Aynı zamanda, Şubat 2025’te zorunlu hale gelen yapay zeka okuryazarlığı kapsamında şirket çalışanlarınızı eğitin.

Kurumların artan regülasyon yükünün altından kalkması ve “Gölge Yapay Zeka” sorununu çözmesi için yapay zekayı yasaklaması değil, güvenli bir şekilde içselleştirmesi gerekir. Tam bu noktada SKYMOD’un SkyStudio platformu ve Goat kurumsal dil modeli devreye girerek şirketlere tasarımdan gelen uyumluluk sunar; yani güvenlik ve regülasyon gereksinimlerini sonradan eklenen bir eklenti olarak değil, şirket içi altyapı, otomatik loglama ve şifreleme özellikleriyle doğrudan sistemin mimarisine en baştan entegre eder

SKYMOD, kurumların regülasyon uyumluluğunu şu şekilde garanti altına alır:

Veri Mahremiyeti ve KVKK/GDPR Uyumu: Şirket içi veya sanal özel ağ (VPC) altyapılarında çalışan “Egemen Yapay Zeka“ ekosistemi, verilerinizin dış bulutlara çıkmasını engeller. Bu sayede KVKK ve GDPR’ın sınır ötesi veri aktarımı kısıtlamalarına tam uyum sağlanırken; ISO 42001, ISO 27001, SOC2, GDPR ve KVKK standartlarında veri güvenliği elde edilir.

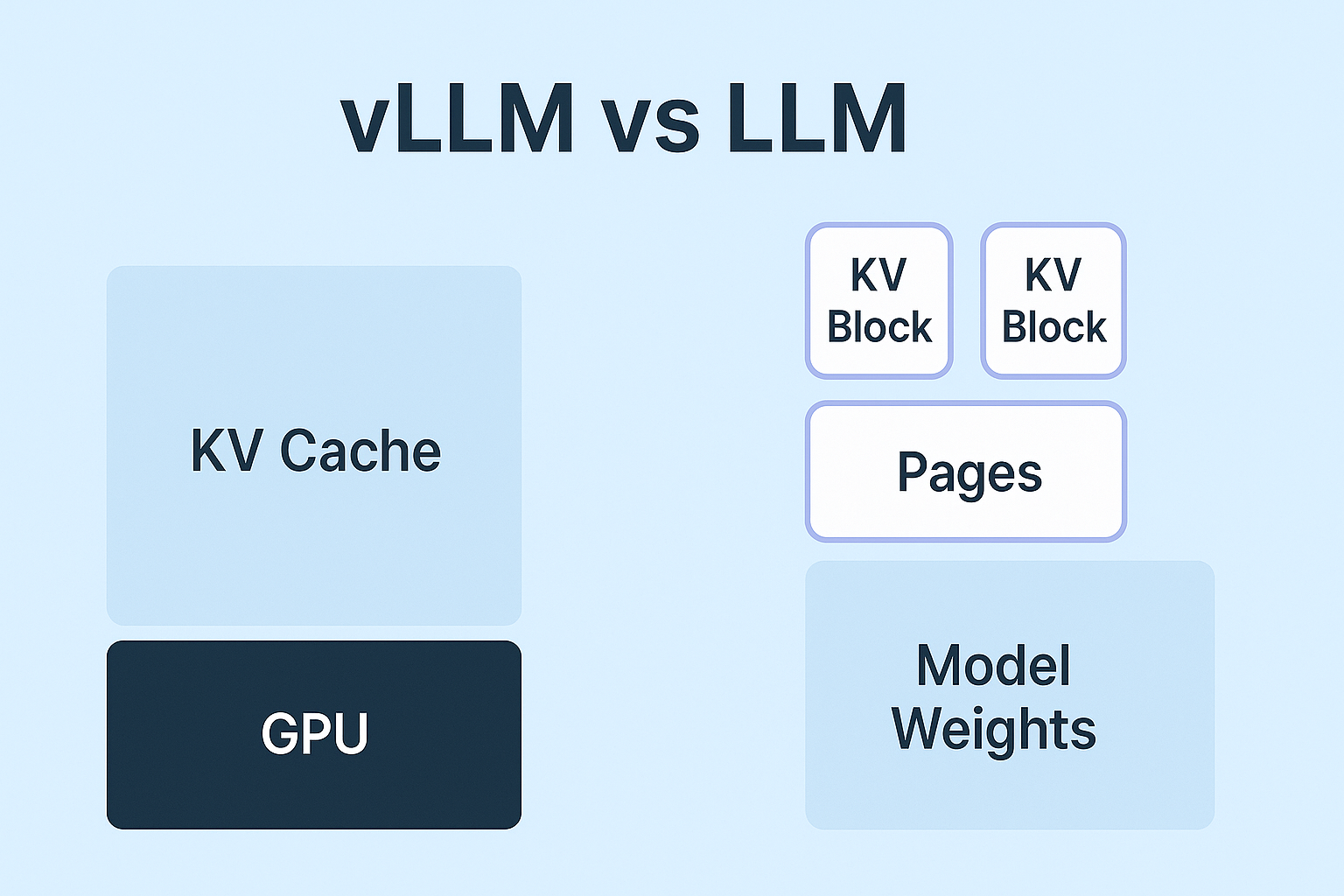

İzlenebilirlik ve EU AI Act Yüksek Risk Uyumu: “EU AI Act”, yüksek riskli sistemler için işlemlerin izlenebilir olmasını ve loglanmasını şart koşar. SkyStudio; rol tabanlı erişim kontrolü (RBAC), uçtan uca şifreleme ve otomatik denetim loglarıyla bu yasal dokümantasyon ve hesap verebilirlik gereksinimlerini doğrudan karşılar.

İnsan Gözetimi (Human Oversight – Madde 14): Yasa, kararların tamamen otonom makinelere bırakılmamasını emreder. SkyStudio‘nun iş akışı otomasyonu, yüksek riskli operasyonlarda “insan onayı” gerektiren mekanizmalar kurmanıza olanak tanıyarak, yasanın 14. Maddesi’ndeki insan gözetimi kuralına teknik altyapı seviyesinde uyum sağlar.

Böylece şirketiniz, karmaşık yasal uyumluluk bariyerlerine takılmadan, yapay zekanın işinize katacağı hıza, verimliliğe ve yeniliğe güvenle odaklanabilir.

Sizin Gibi Çalışan Yapay Zeka (AI) Çalışanları İçin Şimdi Demo İsteyin

Ücretsiz Demonuza Erişmek İçin İletişime Geçin